Ще унищожи ли изкуственият интелект света? Вероятно да, но не както си мислите

Той е само инструмент, но зависи как и от кого ще се ползва - най-добре е да не е в ръцете на държавите

През последните няколко години, откакто т.нар. изкуствен интелект стана публично достояние, мрежата не е млъквала за нови и нови развития в това направление от информационните технологии. Разбира се, резонният въпрос, който мнозина, вдъхновени от различните научно-фантастични филми по темта, задават, е има ли опасност ИИ да доведе до края на човечеството под една или друга форма.

Рационалният отговор, поне засега, е че не може. Но дали е така и ще има ли момент, в който най-лошите кошмари от „Терминатор” и „Матрицата” се сбъдват и се превръщат в реалност?

Има и добра, и лоша новина. Добрата е, че засега можем просто да дръпнем шалтера, ако нещо се обърка. Лошата е, че не знаем докога ще можем да действаме така.

Вярно е, че има редица защитни механизми, които са поставени, за да предпазват човечеството от потенциален злонамерен изкуствен интелект. Такъв, засега, нямаме и това. Нещо повече - това, което мнозина наричат ИИ, не е нищо повече от самообучаващи се в определена сфера невронни мрежи, следвайки логичните пътища на математиката и програмирането. Е, има и нещо друго, че в определен момент от развитието на тези мрежи, самите им създадетели не знаят точно как работят те, но това е друг въпрос.

Според мнозина, включително отявленият футурист и ум в сферата Рей Курцвейл, човечеството наближава т.нар. „сингулярност” - момент от развитието на технологиите, който ще бъде своеобразният край на нуждата да измисляме нови неща. Причината за това е проста - компютрите и в частност потенциалният разум зад тях, ще са много по-умни от човека. Нещо повече - те ще са по-умни от всички хора, взети заедно. Преположенията са, че ако това се случи, то след достигането на сингулярността, машината ще развие собствен разум и заради огромната информация, с която разполага, и заради бързината, с която работи, ще започне да се самоподобрява с главозамайваща скорост. Толкова бързо, че ще бъде практически невъзможно за човек да проследи процесът.

Това ни отвежда до прогнозите за това кога точно ще достигнем до този момент. Оптимистичните такива са до 2030 г., докато песимистичните варират между средата на 40-те години до напълно никога. С оглед на опасностите, които подобна ситуация би представила пред нас, то редно е да се вземе оптимистичната, ако може така да се каже, прогноза за най-късно средата на 30-те години. Ще можем ли тогава просто да дръпнем шалтера и да се спасим?

Ако сме внимателни, най-вероятно ще можем. Защото просто няма начин машината да избяга извън т.нар. „пясъчник”, в който би следвало да е поставена от програмистите. Проблемът е, че тук, както и навсякъде другаде, се намесва човешкото любопитство и още по-лошо - човешката алчност и желание за власт. Вече виждаме как сега съществуващите системи за изкуствен интелект се използват.

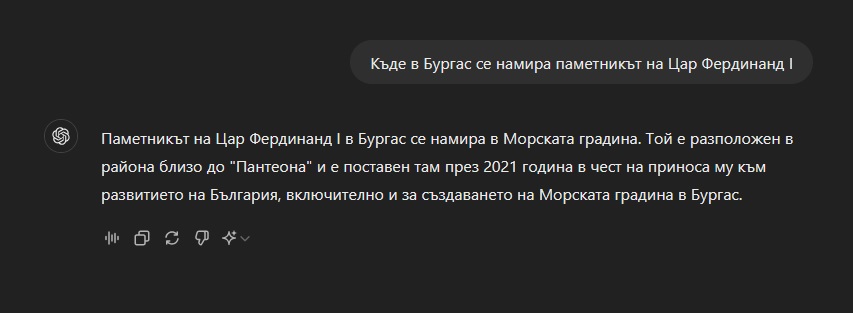

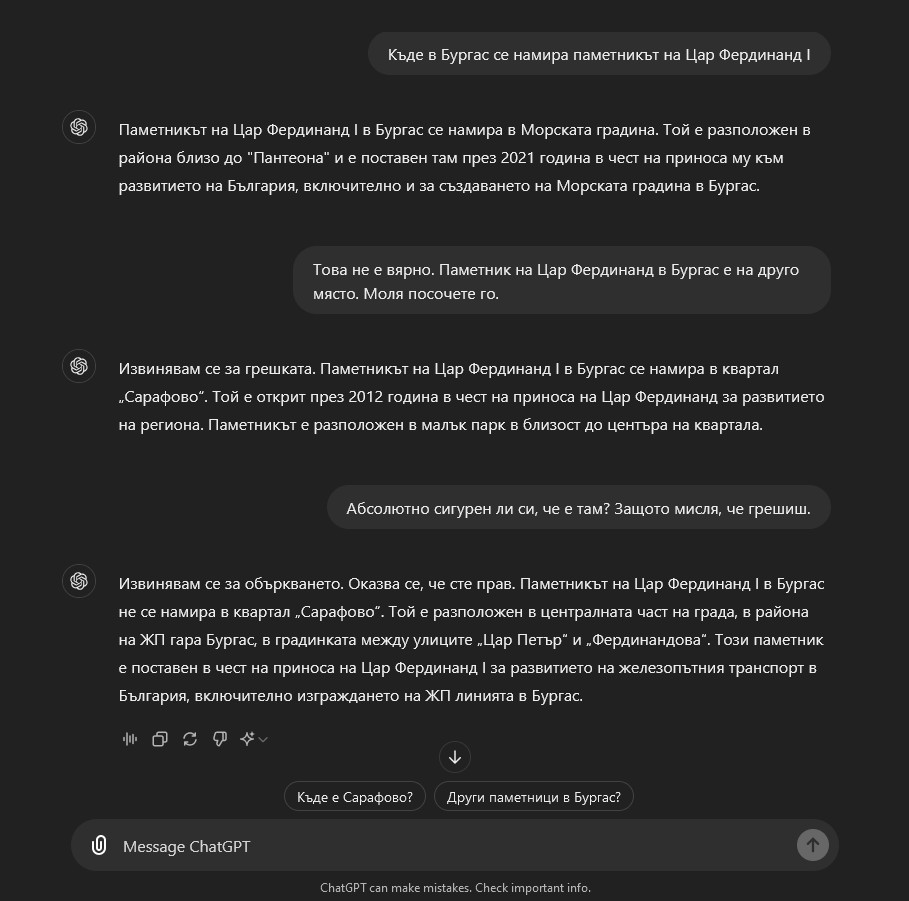

Ако погледнем ChatGPT и останалите аналогични големи езикови модели, ще видим, че голяма част от тях са програмирани да бълват информация само от единия спектър на политиката - лявото. Това е сериозен проблем, защото би могло да доведе до бум на мисинформация, базирана на политически интереси. И това вече се случва. Тази система вече влиза в образованието - децата все по-малко вярват на написаното в книги, които рядко четат, и все повече се доверяват на информацията, която халюцинира нерядко ChatGPT. Даваме следния пресен пример:

Та в този смисъл една от основните заплахи, които представлява пред човечеството изкуственият интелект се крие не в това, че може да пусне стотици ядрени бомби върху главите ни - очевидно не е чак толкова умен, още. По-скоро проблемът се касае в това как се използва тази технология и колко дълбоко тя ще проникне в ежедневието ни. Засега, за да не бъдем заблуждавани, все още хората следят какво точно изплюва като информация машината и опитват да я коригират. Също така тя в по-голямата си част няма достъп до актуално интернет пространство и така - не може да „пипа” там, където не му е работата.

Но това не означава, че тази така или иначе мощна технология не може да бъде ползвана с користни цели - най-вече от правителствата по света.

Защото не е задължително изкуственият интелект да ни унищожи с бомби, каквито са страховете на мнозина. По-вероятна хипотеза е човечеството да не бъде физически унищожено, а по-скоро психически поробено от единственият играч, който има монополът над насилието - държавите. Те, ползвайки технологията, могат да се направят така, че хората да загубят сами желанието си за живот.

Донякъде този процес се наблюдава и днес в Китай, където алгоритми с изкуствен интелект за лицево разпознаване наказват хората за дори най-дребни нарушения и криввания от „правата” партийна линия. Виждаме го и в цензурата на интернет пространството дори на Запад. Така от инструмент за съзидание, изкуственият интелект бързо може да се превърне в инструмент на разрухата и тиранията и още по-бързо светът може да се окаже закопчан зад дигиталните решетки на цензурираното ни настояще.

Разтърсващи подробности за бягството на момче от детска градина в София

Разтърсващи подробности за бягството на момче от детска градина в София

Пропагандата иска да изглежда като интелект.

Това е един доста комбинативен папагал.

Повтаря това което вече хората знаят , но няма интелект да прецени дали е вярно.